每年初夏,科技圈總會迎來一波“新品大秀”,尤其是 5 月和 6 月幾乎成了開發者的“小春晚”的熱鬧時刻——微軟 Build、Google I/O、蘋果 WWDC 輪番登場,帶來一大波新技術、新工具,想方設法吸引開發者的注意。今年是微軟打頭陣,Build 2025 大會于 5 月 20 日凌晨 12:05 率先登場。

這場大會上,微軟 CEO 納德拉和 CTO Kevin Scott 親自上陣,令人意外的是,一直不太對付的 OpenAI CEO Sam Altman 和特斯拉 CEO 馬斯克,還有英偉達 CEO 黃仁勛,也都“出現”在這場大會上,只是以線上視頻接入的形式,分別與納德拉來了場關于合作、大模型、芯片等維度的簡短對話。

整體來看,AI 無疑是微軟最重要的戰略方向。不過,今年「開源」也成了另一大貫穿全場的關鍵詞,其不僅將 VS Code 上 Copilot 的核心功能開放了出來,就連適用于 Linux 的 Windows 子系統(WSL)也重磅開源了,實屬令人意外!

當然,除了這些重磅發布,微軟在這場大會上還有不少值得關注的技術創新。從產品體驗到底層工具,AI 又為整個行業帶來了哪些新變化?下面就一起來看看這場大會到底講了些什么。

納德拉開場z

有個小插曲是——就在納德拉登臺沒幾分鐘,現場似乎有一些抗議者試圖擾亂這場活動,好在大會很快回歸正軌。

“我們正處在一輪平臺變革的‘中局’階段——一切開始迅速擴展、加速演進。”納德拉在開場時這樣描述當下的技術浪潮,“這有點像 1990 年代初 Web 技術剛起步時的情形,或者像 2000 年代云計算和移動互聯網的快速崛起。”

他指出,當前的 2025 年,我們正迎來一個全新的 Web 擴展時代。“從一開始那幾款整合式技術棧的產品出發,我們已經走到一個由云支持、更加開放且可擴展的 Web 架構階段。”

在用于構建軟件的開發者工具方面,數據顯示,Visual Studio 系列產品目前的用戶已超過 1500 萬,GitHub 擁有超過 1.5 億開發者,而 GitHub Copilot 的用戶數也突破了 1500 萬。納德拉對此信心十足:“這一切,才剛剛開始。”

微軟正在不斷打磨開發者的利器

時下,微軟正在不斷升級這些工具:

Visual Studio 迎來多項功能更新,包括支持 .NET 10、引入實時預覽和更流暢的設計時體驗、強化 Git 工具鏈,以及為跨平臺開發打造的新調試器。更新節奏也將調整為每月發布穩定版,讓開發者能更及時獲取新功能。

VS Code 剛剛發布了第 100 個開源版本,新增了多窗口支持,開發者現在可以直接在編輯器中查看和管理暫存區內容。

在 GitHub 方面,微軟正推動 AI 與開源的深度結合。其宣布,將在 VS Code 中開源 Copilot 擴展(https://github.com/microsoft/vscode),并將這些 AI 驅動的功能直接集成到 VS Code 的核心代碼庫中,讓 AI 成為開發體驗的一部分,也為 GitHub Copilot 的持續演進打下基礎。

針對 GitHub Copilot,微軟表示,現在,它已能夠幫助開發者完成如 Java 8 升級至 Java 21,或 .NET Framework 升級至 .NET 9 等版本遷移工作。Copilot 會自動處理依賴項更新、建議修復方案,并從開發者的修改中學習,從而讓整個遷移過程更加順暢、自動化。

微軟還宣布推出一款專為站點可靠性工程(SRE)場景打造的自主代理——Azure SRE Agent。這款 SRE 代理能在發生線上故障時自動啟動,執行初步排查、定位根因并嘗試緩解問題,隨后將事件報告記錄為 GitHub Issue,并附帶完整的修復建議項。開發者可進一步將這些修復任務分配給 GitHub Copilot 繼續處理,從而實現閉環自動化運維。

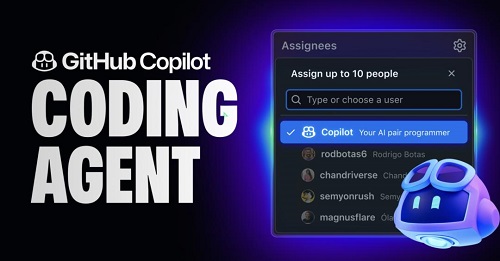

更值得一提的是,微軟首次推出完整意義上的Coding Agent,讓 Copilot 從“對話式編程助手”升級為真正的“協作式開發伙伴”。

新版 Coding Agent 的使用操作非常簡單:只需像分配任務給隊友一樣,把一個或多個 GitHub Issue 分配給 Copilot。你可以在 GitHub 網站、移動端或命令行中完成操作。此外,也可以直接通過 Copilot Chat 在 GitHub 或 VS Code 中發出指令,例如:

@github Open a pull request to refactor this query generator into its own class

一旦接收到任務,Coding Agent 會用 ?? 表情回應,并在后臺啟動工作流程:它會啟動虛擬機、克隆代碼庫、配置環境,并通過 GitHub Code Search 驅動的增強檢索(RAG)技術分析代碼。

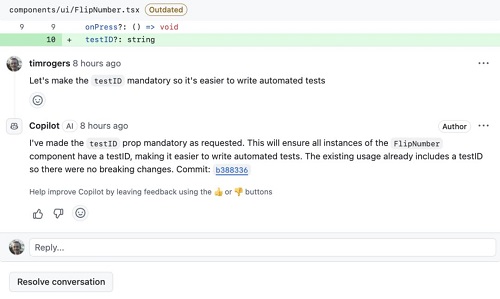

工作過程中,這款代理會持續將修改內容以 Git 提交的形式推送到草稿 Pull Request 中,并更新描述。同時,你可以在會話日志中看到其推理和驗證步驟,方便追蹤思路與識別問題。

借助 Model Context Protocol(MCP),你還能將外部數據和能力接入代理。你可以在代碼庫設置中配置 MCP 服務器,也可以直接調用 GitHub 官方 MCP Server 獲取數據。不僅如此,得益于視覺模型的加持,代理還能“看懂” GitHub Issue 中的圖片,包括 bug 截圖或功能草圖。

任務完成后,Copilot 會標記你進行審核。你可以留下修改建議,代理會自動讀取評論并提出相應的代碼更新。它還會結合相關的 Issue 或 PR 討論內容,以及項目中的自定義說明,確保理解你的意圖并遵循項目規范。

Windows 大改革,WSL 重磅開源!

談及微軟,不得不提的一個操作系統那必然就是 Windows 了。在 Build 2025 大會上,微軟再次強調了 Windows 在 AI 時代的重要角色。

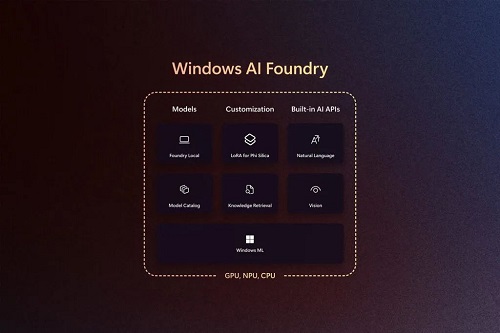

其進一步推出了一項新計劃:Windows AI Foundry,目標是把 Windows 打造成最適合構建 AI 應用的平臺。

簡單來說,Windows AI Foundry是微軟內部用來開發 Windows Copilot、Recall(AI 記憶功能)、一鍵操作等 AI 功能的一整套工具和平臺。現在,這些工具首次向開發者開放,而且覆蓋范圍不限于特定設備或芯片,無論你使用 CPU、GPU、NPU,甚至是在云端運行,都可以開發并部署自己的 AI 應用。

其中一個重要組件叫做Foundry Local,它內置了一個已經優化好的模型庫,開發者可以直接在本地運行這些開源模型,完全不依賴云端。比如微軟自己的Phi-Silica小語言模型,未來將會直接內嵌在 Windows 操作系統中。如果你想讓它做一些定制任務,只需加入一個 LoRA(輕量適配器),就能快速完成“微調”,而不需要再重新訓練整套模型。

微軟認為,Phi-Silica 有望改變 PC 上 AI 推理的格局,讓本地運行 AI 模型變得像調用普通系統功能一樣簡單。而開發者將因此能構建出更貼近用戶、響應更快的智能體驗。

如果你正在構建自己的模型,可以使用 Windows ML,它也是內置的 AI 推理運行時,可在 CPU、GPU 和 NPU 之間提供簡化高效的模型部署。

除了模型本身,微軟還提供了一系列新的 API,讓開發者可以將用戶的本地數據轉化成向量,嵌入模型中,并構建帶有“上下文理解”的 AI 應用——比如混合式 RAG(檢索增強生成)系統。而所有這一切都在用戶設備上完成,不依賴云端,數據也不會上傳,更符合隱私保護的需求。

為了讓這些應用更智能地與系統打通,微軟還宣布 Windows 將原生支持 MCP(模型上下文協議)。這意味著 Windows 將內置多個 MCP 服務,比如文件系統、設置、窗口管理等,開發者可以構建兼容 MCP 的應用,并通過官方注冊表連接這些服務,微軟也會對這些接口進行性能和安全審查,保障用戶體驗和數據安全。

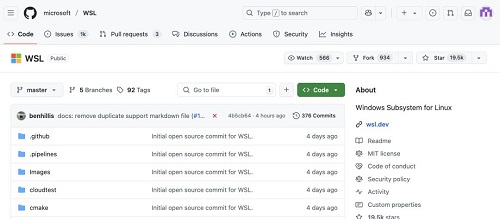

與此同時,令不少開發者頗為興奮的是,Windows 正在深度擁抱開源,而其最新官宣的 WSL 完全開源就是一個很好的證明。

之所以想起來開源,微軟表示,WSL 最早于 2016 年亮相,起初通過 Windows 內核中的 lxcore.sys 實現對 Linux 程序的支持,被稱為 WSL 1。隨著對兼容性的更高要求,微軟在 2019 年推出 WSL 2,引入了完整的 Linux 內核,并陸續支持 GPU、圖形界面和 systemd 等功能。

為了加快開發節奏,微軟在 2021 年將 WSL 從 Windows 中剝離,作為獨立包發布到 Microsoft Store,并在 2022 年推出穩定版 1.0。此后,微軟持續迭代,推動用戶全面轉向新版本,并在 WSL 2.0.0 中帶來了重大更新,包括網絡鏡像、代理支持和防火墻兼容等。

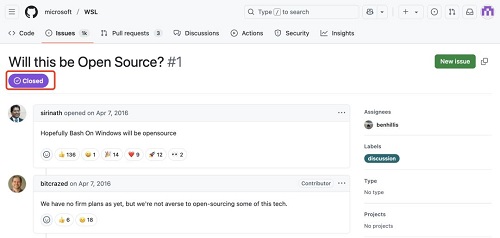

WSL 社區一直是其發展的核心動力,盡管此前無法訪問源代碼,許多開發者仍積極參與調試、反饋和功能建議。對此,納德拉透露,其實早在項目剛啟動時,社區就有人在代碼倉庫里提出希望開源 WSL 的請求。但當時 WSL 深度綁定在 Windows 系統鏡像中,沒法單獨分離出來。如今,隨著架構演進,微軟終于實現了代碼的“松耦合”,WSL 2 已經具備了獨立運作的能力。

如今,WSL 開源后,社區終于可以直接貢獻代碼,這一變革有望進一步推動 Windows 成為跨平臺開發的理想環境。

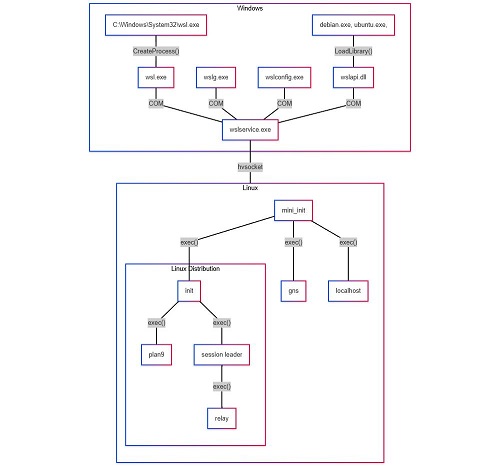

WSL 架構

值此,微軟還“翻出當年的老帖子”,正式把它標記為“已解決”。